来年针对生成性人工智能设定的四个优先事项 媒体

生成式AI的安全挑战与应对策略

关键要点

生成式AI的快速发展使得企业在安全和治理方面面临挑战。大多数IT和安全领导者对生成式AI工具的使用依然存在安全隐忧。安全团队需要关注生成式AI的风险、使用禁令的局限性、政府和行业指导的需求,以及基础网络安全措施的改善。最近,ExtraHop发布的一项调查数据提供了有关IT和安全领导者在生成式AI方面的安全顾虑和策略的宝贵见解。我们对全球1250名IT和安全领导者进行了调查,以了解他们如何确保和治理生成式AI工具在其组织中的使用。尽管许多企业在安全方面还有待加强,技术和安全领导者正面临一个关键的转折点。

根据调查数据,以下是安全团队在未来一年需要围绕生成式AI采取的四项优先事项:

优先事项描述理解生成式AI风险尽管调查显示只有40的受访者担心生成式AI带来的不安全,但36的人提到客户和员工的个人信息暴露是个大问题。超越禁令的考虑超过三分之一的组织选择全面禁止使用生成式AI工具,但调查显示57的机构仍有员工在使用这些工具。依赖权威性政府与行业来源大多数受访者90希望政府参与生成式AI安全问题的处理,且60支持强制性法规。确保基础网络卫生82的受访者对其防御能力保持信心,但实际状况却显示不符合这一信心,绝大多数缺乏监控措施。生成式AI风险的理解

调查显示,IT和安全领导者在生成式AI方面的首要担忧并非安全问题,而是担心收到不准确或毫无意义的回应。这一发现提醒我们,尽管过去一年中生成式AI得到了广泛应用,但许多机构可能并没有优先考虑潜在的安全威胁。随着AI技术的持续进步,我们预计会出现新的产品,以提供生成式AI使用情况的必要可见性。

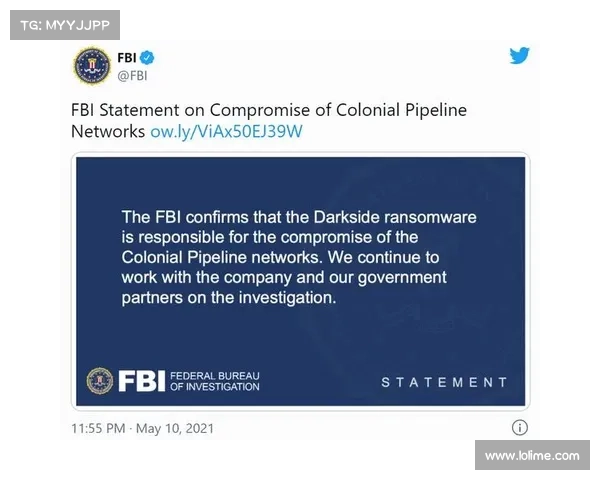

禁令的局限性

自2022年11月OpenAI的ChatGPT对外发布以来,其用户数量迅速超过100万。不过,近三分之一的组织选择了全面禁止使用生成式AI工具,这显示出禁令并没有预期的效果。随着时间的推移,组织对生成式AI的开放程度将逐渐提升。

依赖政府和行业的权威来源

调查结果显示,大部分受访者90希望政府在生成式AI安全方面采取措施,其中60的人支持制定强制性法规。同时,美国成立的国家人工智能咨询委员会NAIAC和拜登政府的AI行政命令为潜在框架的建立提供了基础。

基础网络安全卫生

调查的最后一项发现突显了受访者对防御AI威胁的信心与其实际安全实践之间的显著差距。尽管82的受访者对组织的防御能力表示信心,实际情况却显示少于一半的机构有监控生成式AI工具使用的技术措施,只有46报告有相应的政策。

这表明,由于缺乏监控合规性和确保负责任的AI使用,组织面临安全漏洞的风险。考虑到大多数组织将生成式AI融入其流程,随着安全教育和卫生状况的改善,我们预计在这一领域也将有所改进。

在监控生成式AI使用的同时,员工对这些工具的运作方式、潜在风险以及如何避免不当使用的理解同样重要。组织还应考虑建立跨职能工作组,聚集来自IT、安全、法律、合规等不同领域的代表,共同探索该技术的应用案例并提供培训。

clash中文版企业需要应对生成式AI的动态特性、禁令的局限性、